Вчера, Haiper AI обновилась и позволила генерировать видео по 4 секунды, чуть раньше Runway добавила функционал Lip Sync, а еще раньше Stable video открыли бету для публичного доступа. Что ж, настало то время, когда стоит сравнить 5 самых популярных нейросетей по генерации видео и решить, какие из них лучшие и какими стоит пользоваться.

Методология

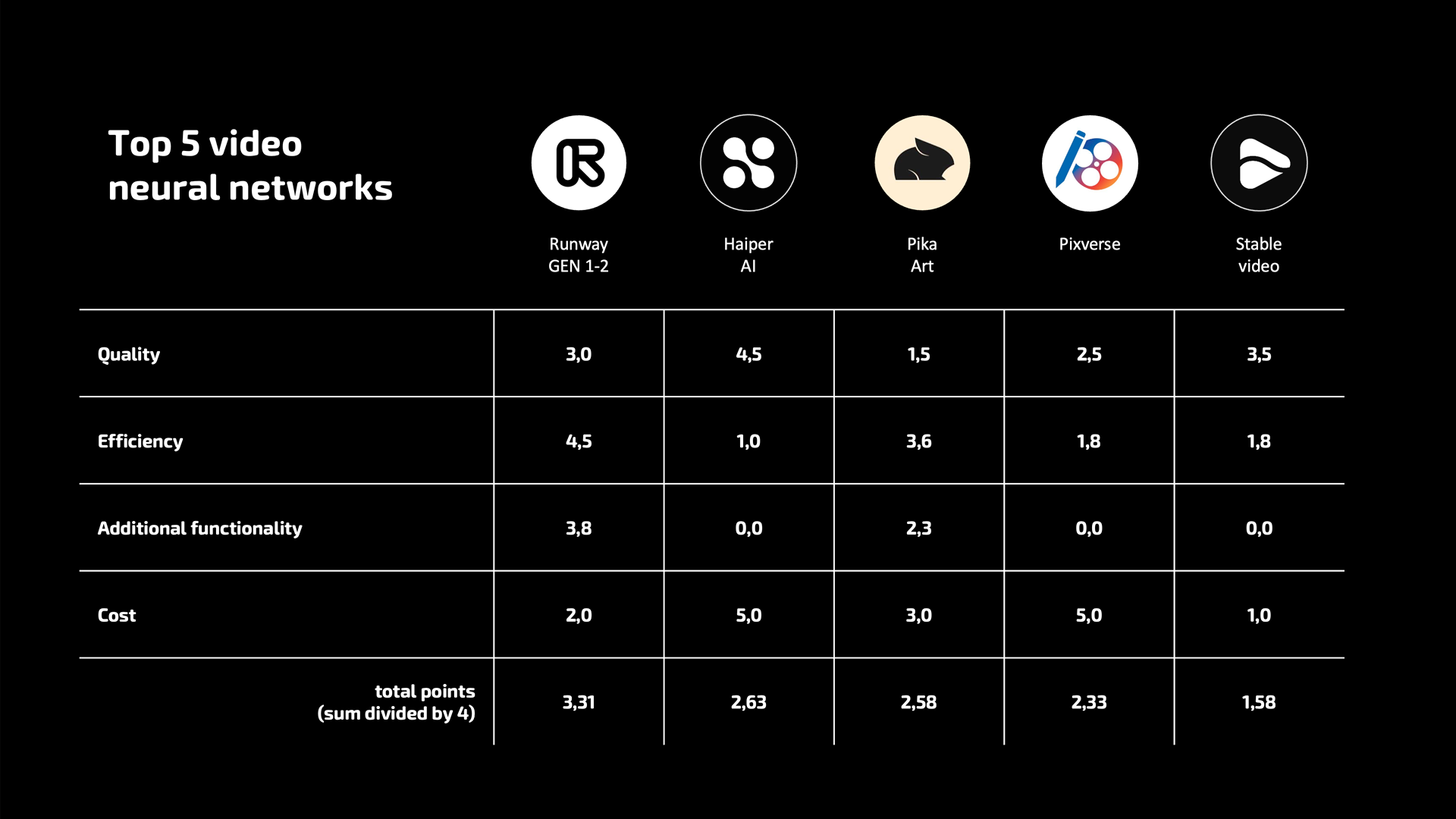

Сравнивать будем по следующим критериям:

- Качество генераций. Здесь оцениваем чисто качество полученного материала.

- Эффективность, или скорость с которой получим видео, соответствующее заданному брифу. Здесь рассмотрим и возможности настройки анимации, и скорость создания генераций, количество одновременных генераций и даже теневые баны.

- Дополнительные возможности от каждого сервиса. Например анимация губ или создание звуковых эффектов, или еще что-то другое.

- Цена. Как за видео, так в целом за проект.

Видео нейронки, которые будут в обзоре:

- Haiper AI https://haiper.ai/

- Runway https://runwayml.com/

- Pixverse https://pixverse.ai/

- Stable Video https://www.stablevideo.com/

- Pika art https://pika.art/

Также есть, Leonardo Motion, в рамках нейросети Leonardo AI https://leonardo.ai/, но по нашему мнению она сильно проигрывает конкурентам. Понимаем, что многие ею могут пользоваться из-за доступности, но мы ни в одном нашем проекте так и не смогли использовать, хотя бы одну генерацию от нее. Поэтому в сравнении ее не будет.

Поехали!

Качество анимаций

Сравнивать будем по четырем направлениям:

- Image to Video, один объект в разных ракурсах. Это самая простая задача для нейросетей. Чем меньше объектов в кадре, тем лучше финальный результат.

- Image to Video, много объектов. Здесь нейросети начинают лагать сильнее и часто путают какому объекту какую анимацию предоставить и появляются различные артефакты и мутации частей тела или мимики.

- Image to Video, быстрое движение. Это самые сложные задачи, особенно анимация конечностей ног при ходьбе, или движении транспорта.

- Text to Video – когда генерируем не из картинки, а из текстового промта. Этот метод полезен в случаях, когда нужно создать сложную анимацию движения из объектов, которые не присутствуют на картинке: полет с одного места на другое, стрельба пулей которая еще не вылетела, молнии и тому подобное.

Для удобства сравнения генераций мы подогнали их под формат Pika Art на 3 секунды.

Что имеем в результате:

Если не учитывать политики безопасности сервисов (ни один не сгенерировал ракету, которая попадает в здание), и не смотреть на анимацию бега, то рейтинг качества следующий:

- Haiper AI по нашему мнению выдает лучшее качество, особенно там где нужно определенное движение и в случаях генерации из текста. 4,5 баллов из 5. Среди минусов только слишком низкая контрастность видео, из-за чего они выглядят бледными. Haiper несомненный лидер по качеству, пока не вышла Sora.

- Stable Video справляется хуже Haiper, но лучше Runway. Контрастность здесь наоборот преувеличена. Реалистичных людей нейросеть анимирует очень плохо, а неодушевленные объекты наоборот лучше многих других. Часто выдает анимации интересных пролетов камеры. 3,5 з 5.

- Runway. Нейросеть лучше других анимирует фото людей, но в остальном разочаровала нас. На фоне первых двух игроков нейросеть выдает неожиданно средний результат. На троечку. Если использовать motion brash качество дотянет и до 4,5 баллов, но это приводит к замедлению анимации. Поэтому Haiper здесь выигрывает. Также, в Runway жесткие требования к политике создаваемого контента, из-за чего определенный контент просто не анимируется. Например сцены с кровью или сцены, которые могут трактоваться, как эротика. Компании нужно уже выпускать модель gen 3, потому что разрыв с другими становится заметным.

- Pixverse. Нечто среднее между Runway и Pika. Иногда генерации бывают лучше чем в Runway, но результаты сильно не стабильные. Также, если не прописывать движение объектов в кадре, то нейросеть часто будет делать zoom in вместо какой-то интересной анимации 2,5 из 5.

- Pika. Здесь худшее качество и стабильность. От 1,5 балла из 5.

Эффективность

Создать качественное видео бывает не достаточно, когда мы говорим о проекте с большим количеством видео сцен. Важную роль играет то, насколько полученное видео попадает в бриф. Согласитесь, даже если вы получили супер качественную генерацию, но в ней человек смеется, вместо стрелять из ружья, это все равно промах и дальше вы будете перегенерировать все с начала. Так же, если вы делаете большое количество видео, но каждое новое видео вы получите не за 40 секунд, а за 5+ минут – работать с такой нейросетью вы скорее всего не сможете.

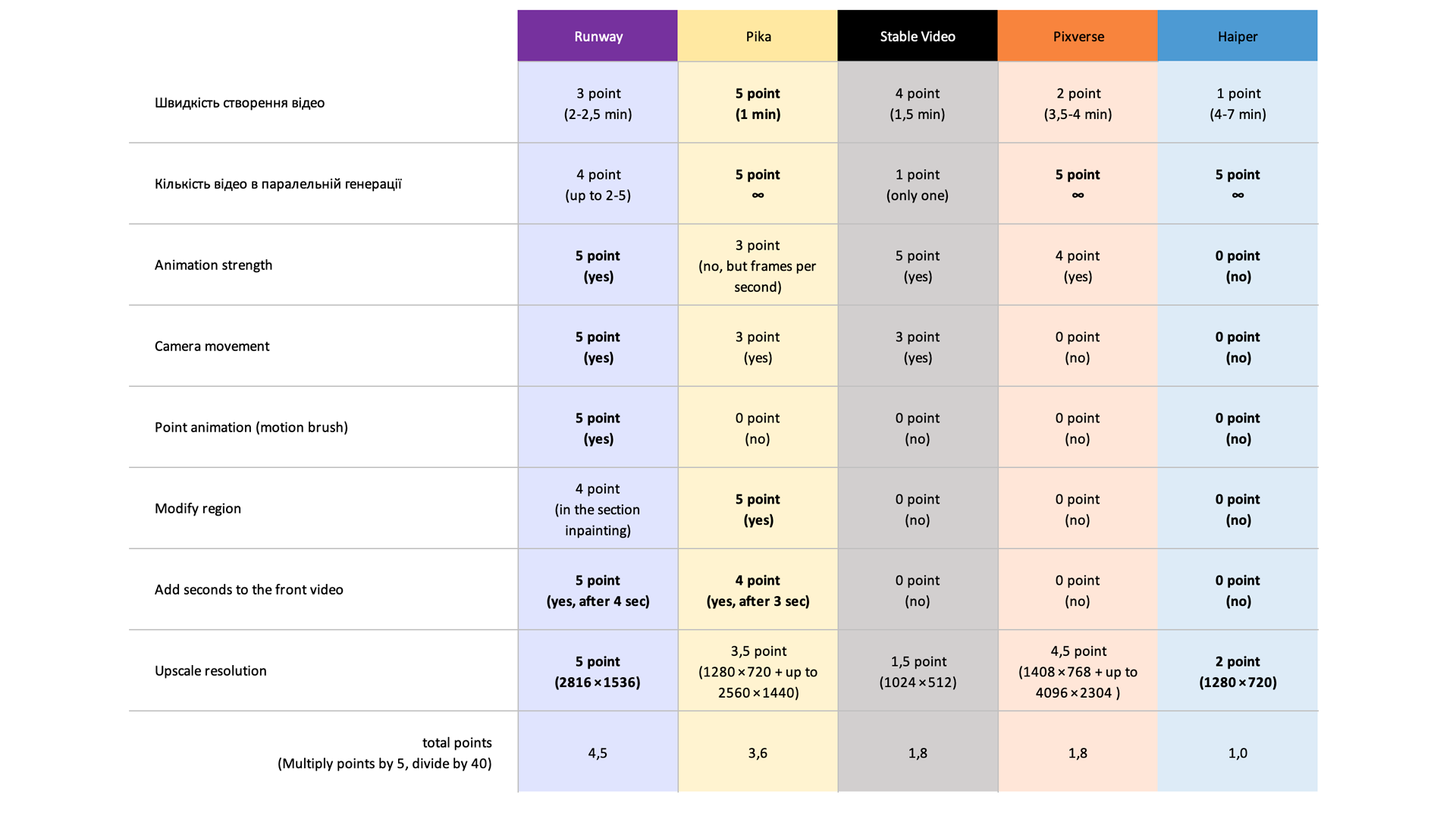

В следующем видео мы рассмотрели все эти нюансы, а в таблице проставили баллы в соответствии с тем, что увидели.

Результаты следующие:

- Runway на первом месте. Главная фишка – точечная анимация через функционал motion brush, что поднимает создание генераций на новый уровень точности. Также в нейросети широчайшие возможности настроек анимации, ее силы и скорости. Из приятного – автоматический апскейл разрешения до 2816 × 1536. Минусы тоже есть – это средняя скорость генераций. Также только в Runway можно поймать теневой бан – если часто будете генерировать по 5 сцен подряд, то вас сначала ограничат до 4-х, потом 3-х и так до 1-й.

- Pika. Нейросеть нас удивила. На первый взгляд, ее функционал не бросается в глаза. Но если закопаться, то можно найти и опции апскейла (до 2560 × 1440), и возможность генерировать дополнительные 4 секунды. Но самые большие преимущества это скорость генерации и возможность редактировать выбранный участок на видео. Даже в Runway инпейнтинг делается отдельной опцией. Также приятно поражает, что можно запустить бесконечное количество параллельных генераций.

- Stable Video и Pixverse, в общем количестве баллов почти одинаковые. Здесь скорее нужно говорить о минусах, потому что функционалы ограничены. Самый главный в Stable Video – низкое разрешение генераций (1024 × 512) и отсутствие параллельных генераций видео. Минусы Pixverse – одна из самых медленных генераций и слабые параметры настроек анимаций. Приятная опции – возможность апскейлить видео до размера 4096×2304.

- Haiper к сожалению самая худшая в плане удобства работы. Единственное что вы можете выбрать это генерировать видео в размере 1280 × 720 на 2 секунды или 4. Надеемся в ближайшее время разработчики это доработают.

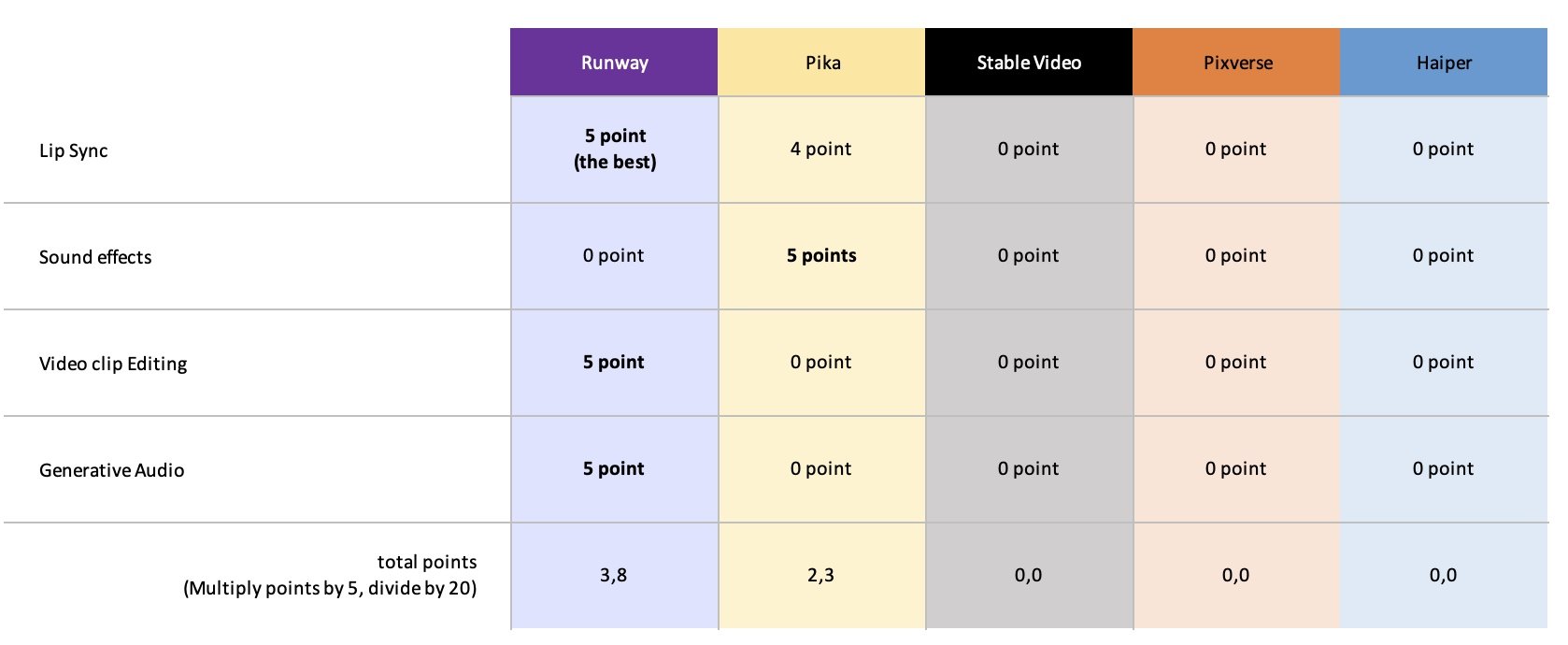

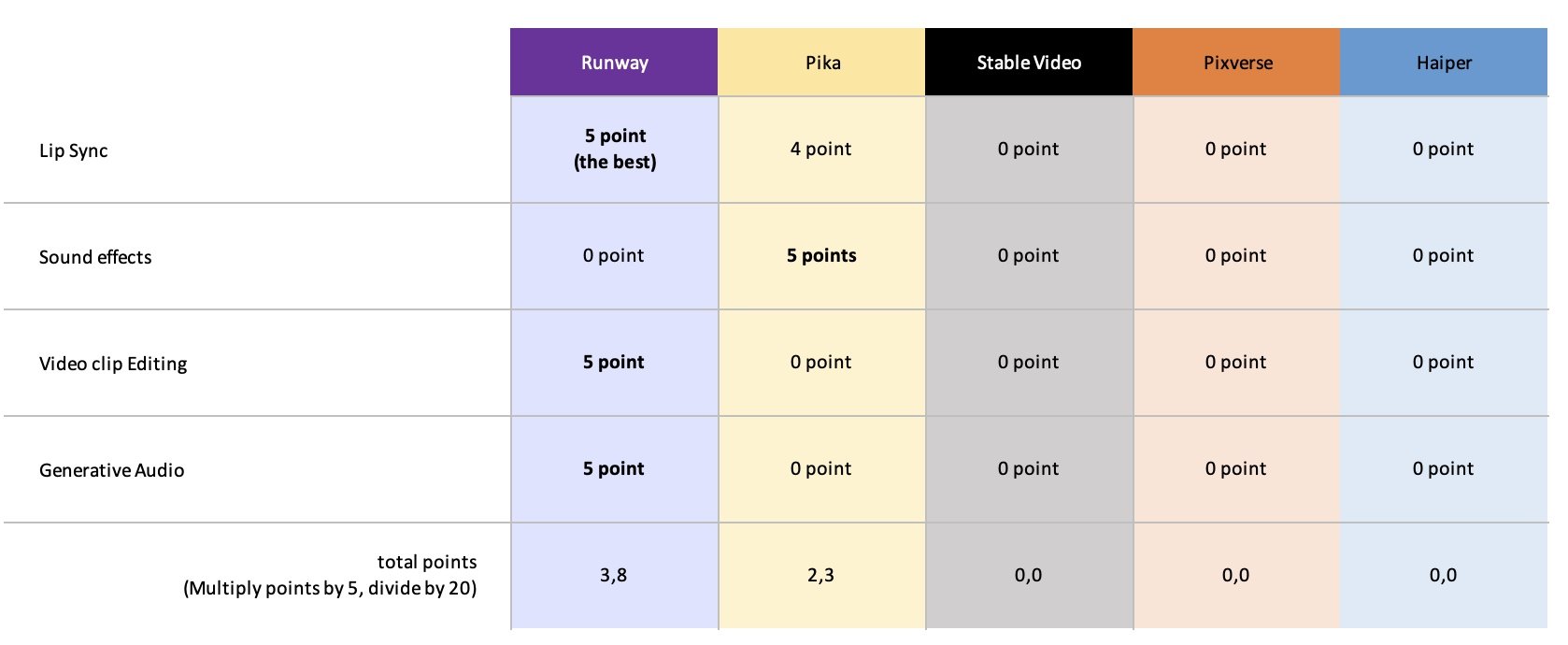

Дополнительные возможности.

Runway позволяет генерировать текст, имеет интерфейс для монтажа всех видео, но самая главная “киллер фича” функция Lip Sync, которая работает даже лучше первопроходца в лице Pika. Единственное преимущество Pika, это возможность создавать звуки предметов, которые отображается на видео. Другие нейросети никаких дополнительных функций не имеют.

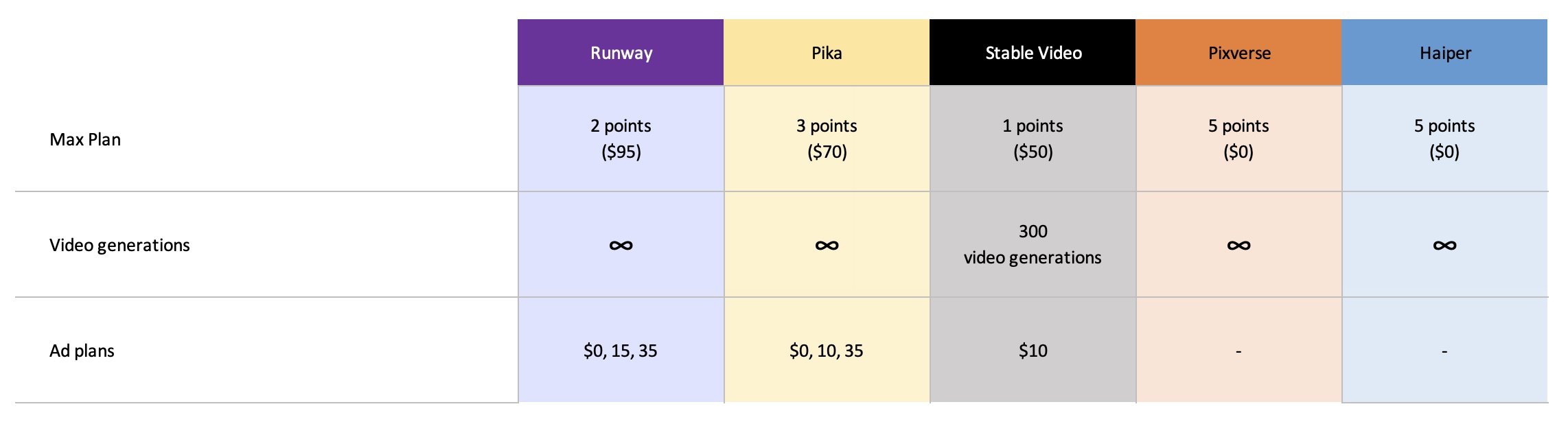

Runway на первый взгляд кажется самой дорогой – максимальный план стоит 95 долларов. Однако этот план дает бесконечное количество генераций. Это очень удобно, потому что в любом видео проекте вам нужно постоянно генерировать различные вариации одной и той же сцены, чтобы выбрать лучшую. Ролик на 3,5 минуты может потребовать создания около 2 тыс. генераций. В таком пересчете Stable Video стоит от 5 до 7 раз дороже, потому что приобрести вы можете только пакет за 50 долларов на 300 генераций видео. Runway также имеет пакеты на 0, 15 и 15 долларов. 15 подойдет для тестирования, а на 35 вам не нужен, лучше приобрести за 95.

Pika работает по модели – смотрите на нас, мы такие же, как и Runway, однако немножечко дешевле, и еще есть функция создания звуков. Также у нее есть бесплатный пакет с ограниченным количеством генераций в день.

Pixverse и Haiper Ai имеют серьезное преимущество на текущий момент, потому что они бесплатные. А генерировать в них можно бесконечное количество видео, да еще и параллельно друг другу.

Выводы

Рейтинг выглядит вот так. Исходя из таблицы возникает вопрос, что же тогда выбрать?

Моя рекомендация следующая:

- В качестве основной видео нейросети выбрать Runway максимальный план, если вы создаете видео на постоянной основе. Runway позволит тонко настраивать силу анимации, а качество генерации с людьми будет наилучшим. Вы сможете удобно создать большую часть сцен вашего видео проекта. Это идеально подходит для рекламных роликов, где в центре сюжета чаще всего живой человек.

- Haiper AI взять на вооружение для дополнительных генераций. Пока вы генерируете видео в Runway запускайте параллельные генерации в Haiper AI, особенно если вам нужны кадры с движением. Да, нейросеть будет делать их медленно, но с высокой вероятностью вы что-то такое красивое получите. На текущий момент в проектах моего агентства New Strategies примерно 20% сцен в ИИ роликах уже создается с помощью Haiper AI. После обновления нейросети и возможностью генерировать по 4 секунды, процент увеличится.

- Pika, интересна лишь бесплатным пакетом и опцией генерации звуков. Пока вы генерируете видео в Runway, бросьте те же самые фото на генерацию в Pika, а потом в программе для монтажа оставьте только звуки. Получится интересно.

- В Stable Video можно приобрести пакет за 10 долларов, и заходить в нейросеть в случаях когда вам нужны интересные пролеты камеры. На остальное она не нужна.

- Pixverse будет интересным бесплатным пакетом тем, кто не генерирует ролики профессионально. Здесь вы можете почувствовать, что такое видео нейро генерации. Также иногда в нее можно зайти для создания видео с большим разрешением на крупные планы.

Спасибо за внимание. Подписывайтесь на мой телеграмм о нейросети Нейродива.